Cách ly và Khả năng quan sát: Kiểm tra Trình duyệt AI từ Google, Microsoft và Edge

By JoeVu, at: 16:38 Ngày 26 tháng 10 năm 2025

Thời gian đọc ước tính: __READING_TIME__ phút

Sự xuất hiện của các tác nhân AI và trình duyệt thông minh như ChatGPT Atlas, Gemini của Google trong Chrome và Copilot của Microsoft đã đặt ra một thách thức mới và nghiêm trọng cho các nhóm bảo mật doanh nghiệp. Sự tiện lợi của AI có thể đọc, tóm tắt và hành động trên các tab đã được xác thực của công ty mang đến một vectơ mới khổng lồ cho việc mất dữ liệu.

Việc lựa chọn một nền tảng trình duyệt AI không phải là về sự tương đồng về tính năng; đó là về quản trị dữ liệu và kiến trúc bảo mật. Các phần sau đây so sánh các chiến lược của nhà cung cấp hàng đầu và phác thảo các yêu cầu kỹ thuật không thể thỏa hiệp cho việc lựa chọn của doanh nghiệp.

Ranh giới dịch vụ doanh nghiệp: Cách tiếp cận Gemini của Google

Google, một người chơi lớn trong không gian trình duyệt AI với việc tích hợp Gemini vào Chrome và Workspace, đã cam kết công khai một Ranh giới dịch vụ doanh nghiệp rõ ràng để bảo vệ dữ liệu công ty.

Lời hứa cốt lõi của họ là cô lập dữ liệu: Nội dung doanh nghiệp bao gồm tất cả các lời nhắc của người dùng, ngữ cảnh từ các tài liệu Workspace (như Docs, Sheets và Gmail) và phản hồi của AI được giới hạn nghiêm ngặt trong miền của tổ chức. Quan trọng là, nội dung này không được sử dụng để đào tạo các mô hình LLM đa mục đích, công khai của Google trừ khi tổ chức chọn tham gia một cách rõ ràng.

Cam kết này được thiết kế để mang lại sự tự tin cho khách hàng doanh nghiệp rằng tài sản trí tuệ (IP) và các giao tiếp nhạy cảm của họ sẽ không vô tình trở thành một phần của dữ liệu đào tạo LLM có thể truy cập công khai, do đó duy trì tính toàn vẹn và bảo mật cho các hoạt động nội bộ của họ.

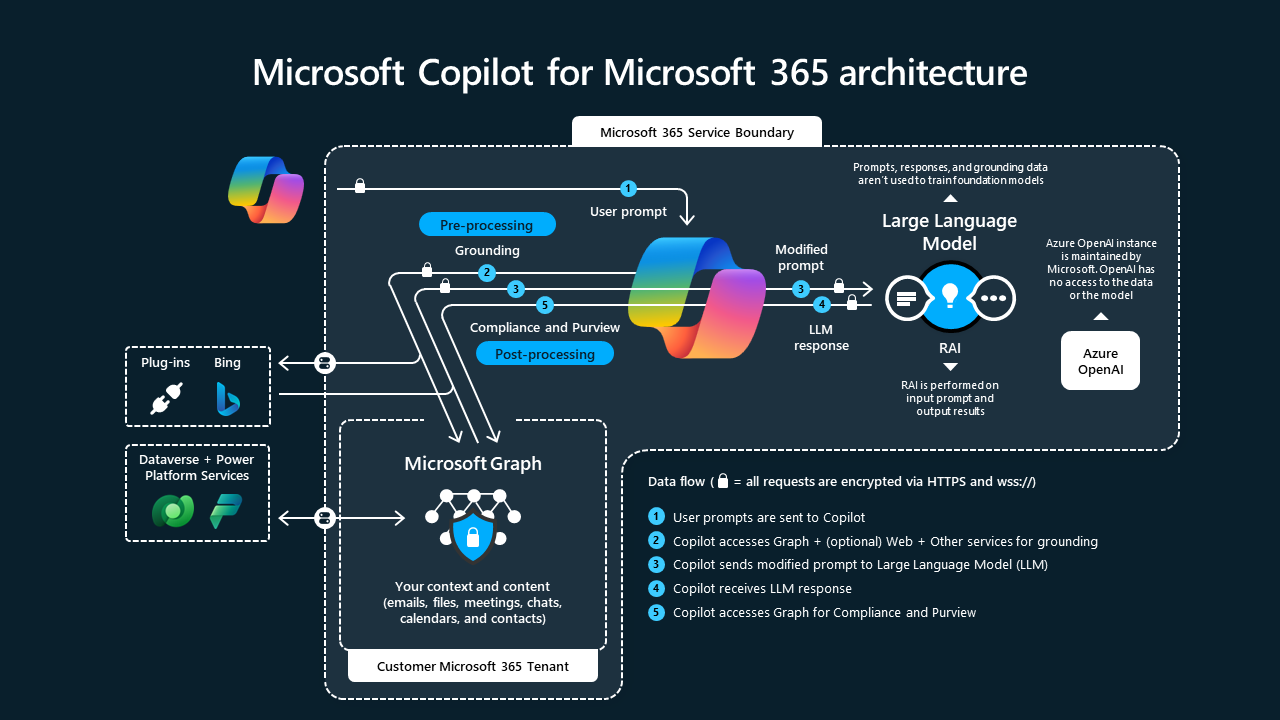

Cam kết cô lập dữ liệu của Microsoft Copilot

Microsoft, với việc tích hợp Copilot trên M365, đã sao chép và tích cực tiếp thị một chiến lược cô lập dữ liệu tương tự.

Sự đảm bảo của Microsoft là các lời nhắc và phản hồi được tạo ra bởi AI sau đó được xử lý hoàn toàn trong ranh giới dịch vụ M365. Điều này có nghĩa là các tương tác AI tự động kế thừa các biện pháp kiểm soát bảo mật và tuân thủ doanh nghiệp hiện có của tổ chức (như Azure Information Protection và eDiscovery).

Cụ thể, Microsoft nêu rõ rằng dữ liệu thương mại này không được sử dụng để đào tạo các mô hình AI nền tảng của họ. Bằng cách giới hạn nghiêm ngặt tương tác trong môi trường tin cậy của người thuê, họ nhằm mục đích mở rộng liền mạch phạm vi bảo mật hiện có của doanh nghiệp sang các tính năng AI mới, giảm thiểu bề mặt tấn công rò rỉ IP của công ty.

Yêu cầu cốt lõi: Cô lập

Các chiến lược của nhà cung cấp này nhấn mạnh một sự thật cơ bản: Ranh giới dịch vụ doanh nghiệp là yếu tố quan trọng nhất để lựa chọn trình duyệt AI.

Trong một môi trường mà một lệnh ngôn ngữ đơn giản có thể bắc cầu dữ liệu qua các ứng dụng đã được xác thực, nguy cơ rò rỉ IP của công ty vào các bộ đào tạo LLM đa mục đích là hiện hữu. Nếu một tác nhân AI xử lý dữ liệu độc quyền từ hệ thống CRM đồng thời thông báo cho mô hình công khai, dữ liệu đó sẽ bị xâm phạm vĩnh viễn.

Do đó, đối với tất cả các công việc nội bộ, từ tóm tắt ghi chú cuộc họp đến soạn thảo email bí mật, một yêu cầu bắt buộc là cô lập. Nền tảng phải chứng minh được việc yêu cầu và thực thi rằng tất cả nội dung nội bộ phải được giới hạn trong miền của doanh nghiệp và rõ ràng loại trừ khỏi các bộ đào tạo công khai của nhà cung cấp mô hình. Đây là cách duy nhất để giảm thiểu rủi ro biến một công cụ tiện lợi thành một nguồn rò rỉ IP thảm khốc.

Thách thức tác nhân: Lập trường doanh nghiệp của Perplexity Comet

Trong khi Google và Microsoft mở rộng bảo mật hệ sinh thái doanh nghiệp hiện có, Perplexity Comet gia nhập thị trường với tư cách là một trình duyệt chuyên dụng, lấy AI làm trung tâm, với tính năng cốt lõi là khả năng tác nhân (khả năng thực hiện các tác vụ đa bước tự động trên web). Sự khác biệt trong thiết kế này đòi hỏi sự xem xét kỹ lưỡng riêng biệt.

Cung cấp doanh nghiệp của Perplexity đưa ra các tuyên bố cô lập dữ liệu mạnh mẽ:

-

Không sử dụng Dữ liệu Doanh nghiệp để Đào tạo: Giống như các đối thủ cạnh tranh lớn hơn, Perplexity tuyên bố rằng dữ liệu khách hàng doanh nghiệp không bao giờ được sử dụng để đào tạo hoặc tinh chỉnh các mô hình LLM của họ (bao gồm cả những mô hình từ các đối tác bên thứ ba).

-

Tuân thủ và Bảo mật: Nền tảng quảng cáo tuân thủ SOC 2 Loại II, GDPR và HIPAA, cùng với các tính năng như Đăng nhập một lần (SSO), quản lý người dùng và thu thập nhật ký kiểm toán, định vị mình là một đối thủ cạnh tranh doanh nghiệp hợp pháp.

Tuy nhiên, bản chất tác nhân lại tạo ra các vectơ độc đáo. Nghiên cứu bảo mật gần đây đã nêu bật các lỗ hổng trong trình duyệt AI, bao gồm cả Comet, liên quan đến tiêm lệnh gián tiếp thông qua các yếu tố được ngụy trang khéo léo (như văn bản ẩn trong ảnh chụp màn hình hoặc URL độc hại). Điều này nhấn mạnh rằng mặc dù chính sách cô lập dữ liệu chính thức có thể hợp lý, nhưng diện tích bề mặt tấn công tiềm ẩn của một tác nhân có tính tự động cao lớn hơn và phải được xác thực liên tục.

Các giải pháp mới nổi: Trình duyệt không giao diện, cô lập

Ngoài các công ty lớn, các giải pháp chuyên biệt đang nổi lên, đặt sự cô lập kiến trúc lên hàng đầu trong chiến lược phòng thủ của họ. Các nền tảng như Browserbase sử dụng các phiên bản trình duyệt không giao diện, cô lập (các trình duyệt chạy ngầm mà không có giao diện người dùng hiển thị) để thực hiện các tác vụ do AI điều khiển.

Kiến trúc này coi mỗi tác vụ AI là một phiên mới, được cách ly, cung cấp bảo mật và tuân thủ tối đa. Toàn bộ hoạt động, từ truy cập một trang đến chạy tập lệnh AI, đều được giới hạn trong một môi trường tạm thời, không bền vững và hoàn toàn cô lập. Đối với các ngành được quy định nghiêm ngặt (ví dụ: những ngành yêu cầu tuân thủ SOC-2 hoặc HIPAA), sự cô lập kiến trúc này thường là biện pháp phòng thủ chính cần thiết chống lại các cuộc tấn công zero-day chưa biết và các vectơ tiêm lệnh phức tạp.

Yêu cầu bắt buộc: Khả năng quan sát đầy đủ

Yêu cầu kỹ thuật cuối cùng, bất kể nhà cung cấp nào, là Khả năng quan sát đầy đủ.

Vì các cuộc tấn công tiêm lệnh lén lút trông giống như các hành động người dùng vô hại, việc phát hiện hoàn toàn phụ thuộc vào một dấu vết pháp y toàn diện. Khả năng quan sát đầy đủ phải bao gồm:

-

iFrames xem trực tiếp: Khả năng cho các nhóm bảo mật xem phiên trình duyệt của tác nhân AI theo thời gian thực hoặc phát lại chính xác những gì tác nhân "thấy" và "làm".

-

Ghi lại toàn bộ phiên: Một bản ghi đầy đủ, có độ trung thực cao về toàn bộ quy trình làm việc do AI điều khiển, bao gồm tất cả các tương tác trang.

-

Ghi nhật ký lệnh: Một dấu vết kiểm toán chi tiết ghi lại mọi hướng dẫn mà AI nhận được (bao gồm cả các lệnh gián tiếp, ẩn) và mọi hành động mà nó thực hiện (ví dụ: "Nhấp vào 'Gửi Email'," "Sao chép dữ liệu vào bảng nhớ tạm").

Mức độ hành động AI có thể kiểm tra và ghi nhật ký lệnh này là thiết yếu cho việc phát hiện mối đe dọa và ứng phó sự cố. Nếu không có nó, một cuộc tấn công Tiêm lệnh gián tiếp, thực thi và lấy cắp dữ liệu trong mili giây, sẽ hoàn toàn không nhìn thấy được, khiến đội ngũ bảo mật mù lòa về phương thức và mức độ vi phạm dữ liệu. AI không chỉ phải hoạt động trong phạm vi dịch vụ mà còn phải đủ minh bạch để được giám sát ở cấp độ lệnh.